Une brève déclaration publiée par le Center for Artificial Intelligence Security et signée par des experts et des personnalités bien connues dans le domaine de la technologie, comme le PDG d' OpenAI , Sam Altman , a souligné que l'intelligence artificielle pourrait générer d'éventuels événements d'« extinction ». € pour la société.

La déclaration, qui est réduite à seulement un paragraphe introductif et une dernière phrase, indique que tandis que les moyens de réglementer les intelligences artificielles sont en cours de débat, l'attention doit se concentrer sur l'atténuation des dangers potentiels que l'IA peut apporter en créant des versions beaucoup plus avancées de celles-ci. programmes .

"Atténuer le risque d'extinction de l'IA devrait être une priorité mondiale avec d'autres risques pour la société tels que les pandémies et la guerre nucléaire", conviennent des experts, dont Demis Hassabis, PDG de Google DeepMind ; Kevin Scott, CTO de Microsoft , Jaan Tallinn, co-fondateur de Skype , entre autres scientifiques et personnalités bien connues.

Bien qu'Altman ait indiqué dans des interviews au cours de l'année 2023, que l'intelligence artificielle a la capacité de dominer le monde telle qu'elle est présentée dans les films, il a assuré qu'il craignait qu'elle ne soit utilisée pour générer du contenu visant à désinformer les gens.

Même si Altman a assuré que ces programmes bénéficient du contact avec l'humain et permettent d'identifier et de corriger les petites erreurs avant que les plus grosses ne soient générées, il était très favorable à une réglementation de ce type de technologie pour protéger la sécurité des utilisateurs sur internet .

Cependant, la position du PDG d' OpenAI sur la réglementation semble beaucoup dépendre de ce qu'il considère comme approprié. Déjà en plein débat sur un éventuel règlement de contrôle pour les pays membres de l'Union européenne, Altman a fait remarquer que la proposition initiale lui paraissait excessive.

Le représentant de l'entreprise a indiqué qu'elle essaierait de se conformer au mieux aux normes du Parlement européen , mais si elle ne le pouvait pas, elle devrait fermer ses opérations dans cette partie du monde. Il a indiqué plus tard qu'OpenAI "n'a pas l'intention de quitter l'Europe".

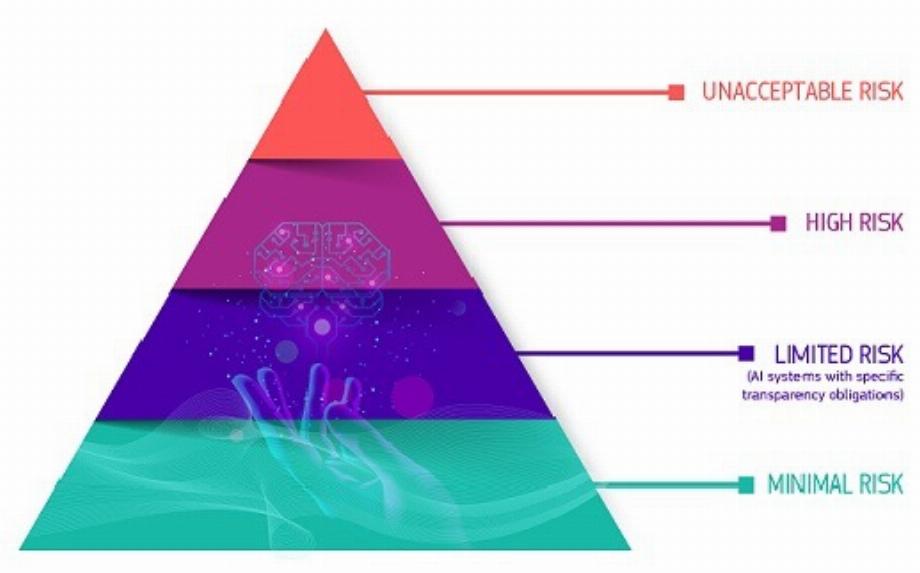

Actuellement, l'Union européenne, par l'intermédiaire de la Commission européenne , débat toujours d'une proposition de réglementation de l'intelligence artificielle basée sur une pyramide des risques. La proposition stipule que les IA qui souhaitent entrer sur ce marché doivent avoir des normes de sécurité pour être admises. Si ceux qui y accèdent ont des problèmes de sécurité , ils doivent faire l'objet d'un veto, les résoudre et réintégrer.

Italie contre ChatGPT

En raison de la popularité croissante de l'intelligence artificielle générative, comme dans le cas de ChatGPT et de ses différentes versions telles que GPT-3.5 et GPT-4, les inquiétudes concernant la sécurité des utilisateurs et de leurs informations personnelles ont augmenté dans différents pays du monde. .

L'Italie a été l'une des premières à s'occuper de ce problème, allant même jusqu'à interdire temporairement l'accès à ChatGPT jusqu'à ce que les problèmes de cybersécurité de la plateforme soient résolus.

L'interdiction a duré plusieurs jours entre le 31 mars et le 13 avril 2023, quelques jours seulement avant la sortie de la fonctionnalité d'historique de chat clair de ChatGPT , donnant aux utilisateurs la possibilité de choisir si leurs conversations pouvaient être utilisées pour entraîner l'intelligence artificielle .