Après avoir bloqué son accès en Italie pour avoir été impliqué dans une controverse concernant les risques potentiels pour la vie privée des personnes, l'intelligence artificielle et la société qui la développe, OpenAI , feront l'objet d'une enquête du gouvernement canadien pour avoir prétendument collecté des informations personnelles sans le consentement du utilisateurs.

Philippe Dufresne , chef du Commissariat à la protection de la vie privée du Canada , a indiqué que les actions de ChatGPT ne se limitent pas seulement à la collecte d'informations, mais qu'elles auraient été utilisées et même divulguées. L'enquête sur le logiciel et la société de Sam Altman, OpenAI , est toujours en cours, donc aucune autre information n'est connue sur la méthode qui a été utilisée pour collecter les données et le type d'informations qui auraient été diffusées.

Selon Dufresne, l'usage fait de l'intelligence artificielle et quels sont ses éventuels effets (ou dommages) sur la vie privée des citoyens est l'une de ses priorités, en plus d'anticiper les avancées des entreprises qui développent ce type de logiciels.

C'est pourquoi, comme cela a été fait en Italie, on s'attend à ce que le gouvernement canadien applique également une suspension temporaire du service jusqu'à ce qu'une base juridique soit générée pour l'utilisation de ce type d'outils et le traitement des données de chaque utilisateur dans eux.

Pour le moment, Sam Altman a déjà indiqué qu'il respectera la mesure établie en Italie sur la disponibilité de ChatGPT et il est possible que le même effet se produise également au Canada, bien que cela n'empêcherait pas les utilisateurs qui souhaitent accéder à leurs services de le faire via un VPN pour changer l'emplacement de votre ordinateur ou de votre téléphone portable à celui d'un autre pays qui le permet.

La régulation de l'intelligence artificielle avance

Les tentatives des gouvernements du Canada et de l'Italie pour répondre à l'avancée de la technologie de l'intelligence artificielle ne sont pas les seules ni les premières à tenter de faire face à un scénario dans lequel ce type de logiciel progresse de plus en plus vite.

La Unión Europea también está intentando proteger a sus países miembros por medio de una legislación en la que se considera como parte de los criterios para “dar permiso” de operar a una inteligencia artificial el posible impacto negativo que esta tendría potencialmente entre los habitantes de diversos les pays.

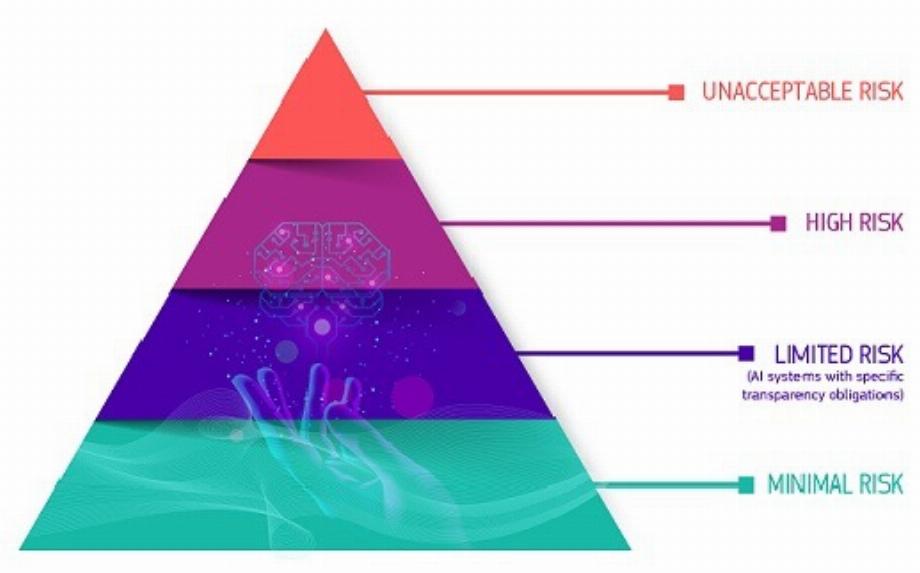

Cette tentative de réglementation, existant depuis 2021 , comporte quatre catégories dans lesquelles l'intelligence artificielle peut être classée comme risque minimal, risque limité, risque élevé et risque inacceptable. L'objectif est que chacun d'entre eux dispose d'un ensemble de règles et de normes de sécurité minimales qu'ils devront respecter pour "éviter des résultats indésirables" malgré le fait qu'il est également reconnu que la plupart de ces systèmes ne présentent pas trop de des risques.

Selon la Commission européenne , vous devrez analyser les risques, puis demander aux développeurs de créer des mesures qui diminuent la quantité d'effets négatifs potentiels avant de vous inscrire correctement.

Dans le cas où ces logiciels développeraient de nouvelles capacités ou fonctions, les gouvernements replaceraient l'intelligence artificielle dans le processus d'obtention des autorisations jusqu'à ce que les risques de mise en œuvre de ces changements soient réanalysés et que des solutions possibles aux problèmes posés par celle-ci soient proposées à la Commission européenne . .